- Większość organizacji ogranicza korzystanie z generatywnej sztucznej inteligencji (GenAI) ze względu na prywatność i bezpieczeństwo danych. 27 proc. z nich całkowicie zakazało pracownikom jej używania, przynajmniej tymczasowo – ujawnia Cisco 2024 Data Privacy Benchmark Study.

- 48 proc. badanych przyznaje się do wprowadzania niepublicznych informacji do narzędzi GenAI.

- 91 proc. firm przyznaje, iż musi zrobić więcej, aby zapewnić klientów, iż ich dane są wykorzystywane przez sztuczną inteligencję do zamierzonych i zgodnych z prawem celów

- 98 proc. ankietowanych stwierdziło, iż zewnętrzne certyfikaty prywatności są ważnym czynnikiem przy podejmowaniu decyzji zakupowych, co stanowi najwyższy poziom od lat.

Cisco opublikowało badanie Data Privacy Benchmark Study 2024, coroczny przegląd kwestii prywatności i ich wpływu na biznes. Wyniki badania podkreślają rosnące wyzwania związane z brakiem zaufania ze strony konsumentów, przed którymi stoją organizacje wykorzystujące sztuczną inteligencję oraz zwroty z inwestycji w prywatność. Bazując na odpowiedziach 2600 specjalistów ds. prywatności i bezpieczeństwa w 12 krajach, siódma edycja badania pokazuje, iż prywatność to znacznie więcej niż kwestia zgodności z przepisami.

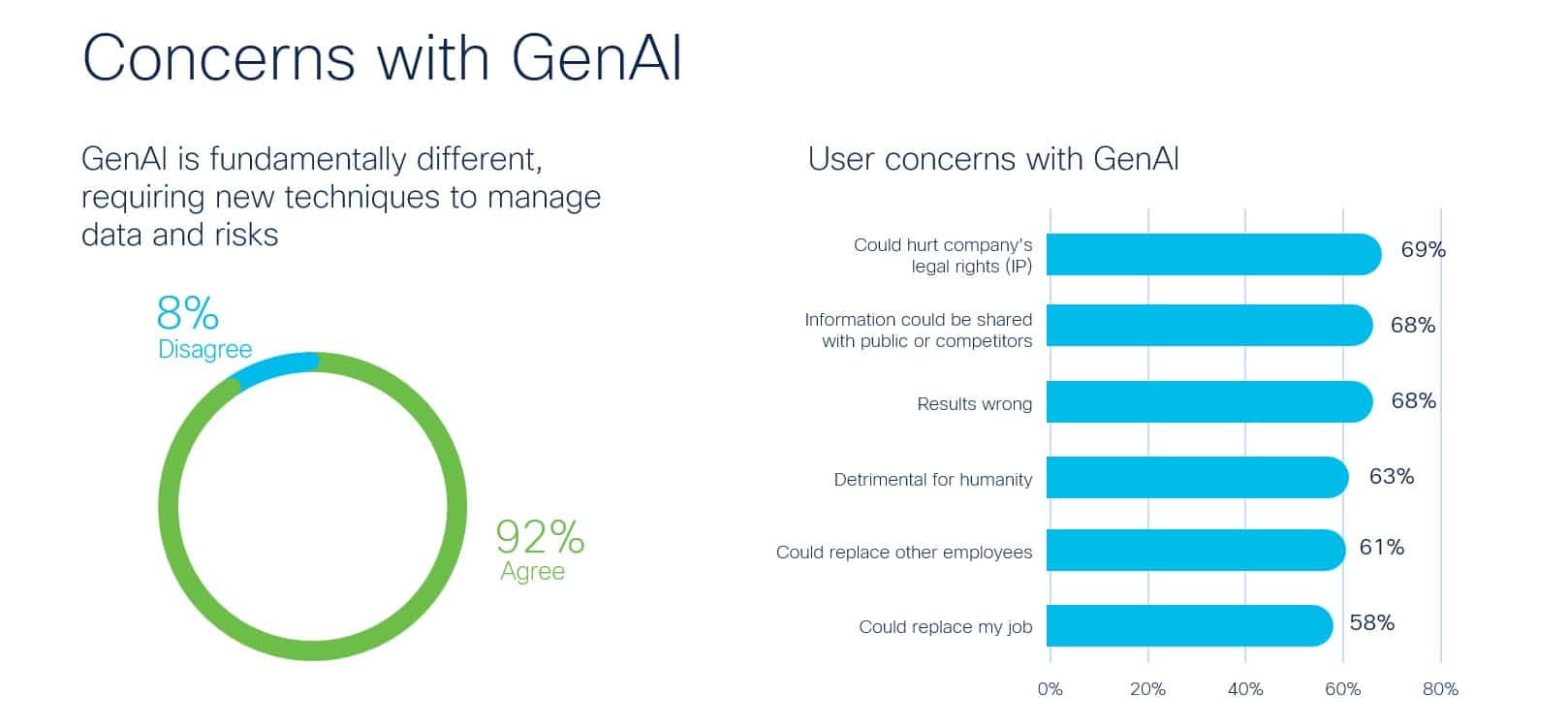

„Firmy postrzegają GenAI jako całkowicie odmienną technologię, która stawia przed nimi nowe wyzwania” – powiedziała Dev Stahlkopf, Cisco Chief Legal Officer. „Ponad 90 proc. respondentów uważa, iż GenAI wymaga nowych technik zarządzania danymi i ryzykiem. W tym miejscu do gry wkracza przemyślane zarządzanie. Od tego zależy utrzymanie zaufania klientów”.

Wśród najważniejszych obaw firmy wymieniły zagrożenia związane z własnością intelektualną danych opracowanych przez AI (69 proc.) oraz ryzyko ujawnienia informacji opinii publicznej i/lub konkurencji (68 proc.).

Obawy związane z GenAI

Większość podmiotów zdaje sobie sprawę z tych zagrożeń i wprowadza odpowiednie mechanizmy kontroli:

- 63 proc. firm posiada ograniczenia jakie dane można wprowadzać,

- 61 proc. wykluczyło część narzędzi GenAI w swoich organizacjach,

- 27 proc. zakazało używania wszelkich narzędzi opartych o GenAI, przynajmniej tymczasowo

Wiele osób wprowadziło do nich dane, które mogą być problematyczne, w tym informacje o pracownikach (45 proc.) lub niepubliczne materiały firmowe (48 proc.).

Przejrzystość procedur – zapotrzebowanie rośnie, postępów brak

Konsumenci są zaniepokojeni wykorzystaniem sztucznej inteligencji w zakresie przetwarzania ich danych osobowych. 91 proc. organizacji przyznaje, iż muszą zrobić więcej, aby zapewnić swoich klientów o wykorzystaniu informacji wyłącznie do zamierzonych i zgodnych z prawem celów. Wynik jest na poziomie zbliżonym do rezultatów zeszłorocznego badania, co sugeruje, iż nie osiągnięto w tym zakresie znacznego postępu.

Potrzeby firm w zakresie budowania zaufania różnią się od priorytetów ich klientów. Konsumenci wskazali, iż najbardziej palącymi problemami jest uzyskanie jasnych informacji na temat sposobu wykorzystania ich danych oraz uniknięcie sprzedaży tych informacji w celach marketingowych.

Z kolei dla firm priorytetami są przestrzeganie przepisów dotyczących prywatności (25 proc.) i unikanie naruszeń danych (23 proc.). Sugeruje to, iż dodatkowe skupienie się na przejrzystości procesu przetwarzania danych byłoby wskazane – szczególnie w przypadku aplikacji AI, w których może być trudno zrozumieć, w jaki sposób algorytmy „podejmują” decyzje.

Prywatność i zaufanie: rola zewnętrznych certyfikatów i przepisów prawa

Organizacje zdają sobie sprawę z potrzeby dostarczenia klientom informacji, w jaki sposób wykorzystywane są ich dane, a 98 proc. stwierdziło, iż zewnętrzne certyfikaty prywatności są ważnym czynnikiem przy podejmowaniu decyzji o zakupie. Jest to najwyższy wynik w historii badania.

„94 proc. firm stwierdziło, iż klienci nie kupowaliby od nich, gdyby nie ochrona danych konsumenckich” – wyjaśnia Harvey Jang, dyrektor ds. prywatności w Cisco. „Konsumenci szukają twardych dowodów na to, iż organizacjom można zaufać. Prywatność stała się nieodłącznie związana z zaufaniem i lojalnością klientów. Era AI unaocznia ten proces jeszcze bardziej – inwestowanie w prywatność lepiej pozycjonuje firmy do etycznego i odpowiedzialnego wykorzystywania sztucznej inteligencji”.

Pomimo kosztów i wyzwań dla firm, jakie powodują przepisy dotyczące prywatności, 80 proc. respondentów stwierdziło, iż legislacje dotyczące prywatności miały pozytywny wpływ na ich organizacje, a tylko 6 proc. stwierdziło, iż wpływ ten był negatywny. Zmiany prawne dotyczące prywatności zwiększają zaufanie konsumentów do organizacji, w wyniku czego decydują się udostępniać im swoje dane.

Ponadto wiele rządów i organizacji wprowadza wymagania dotyczące przechowywania danych na terytorium ich pozyskiwania, aby zachować określone informacje w kraju lub regionie. Podczas gdy większość firm (91 proc.) uważa, iż ich dane byłyby z natury bezpieczniejsze, gdyby były przechowywane w kraju lub regionie pochodzenia, 86 proc. stwierdziło również, iż działająca na skalę globalną firma, może lepiej chronić ich dane w porównaniu z lokalnym dostawcą.

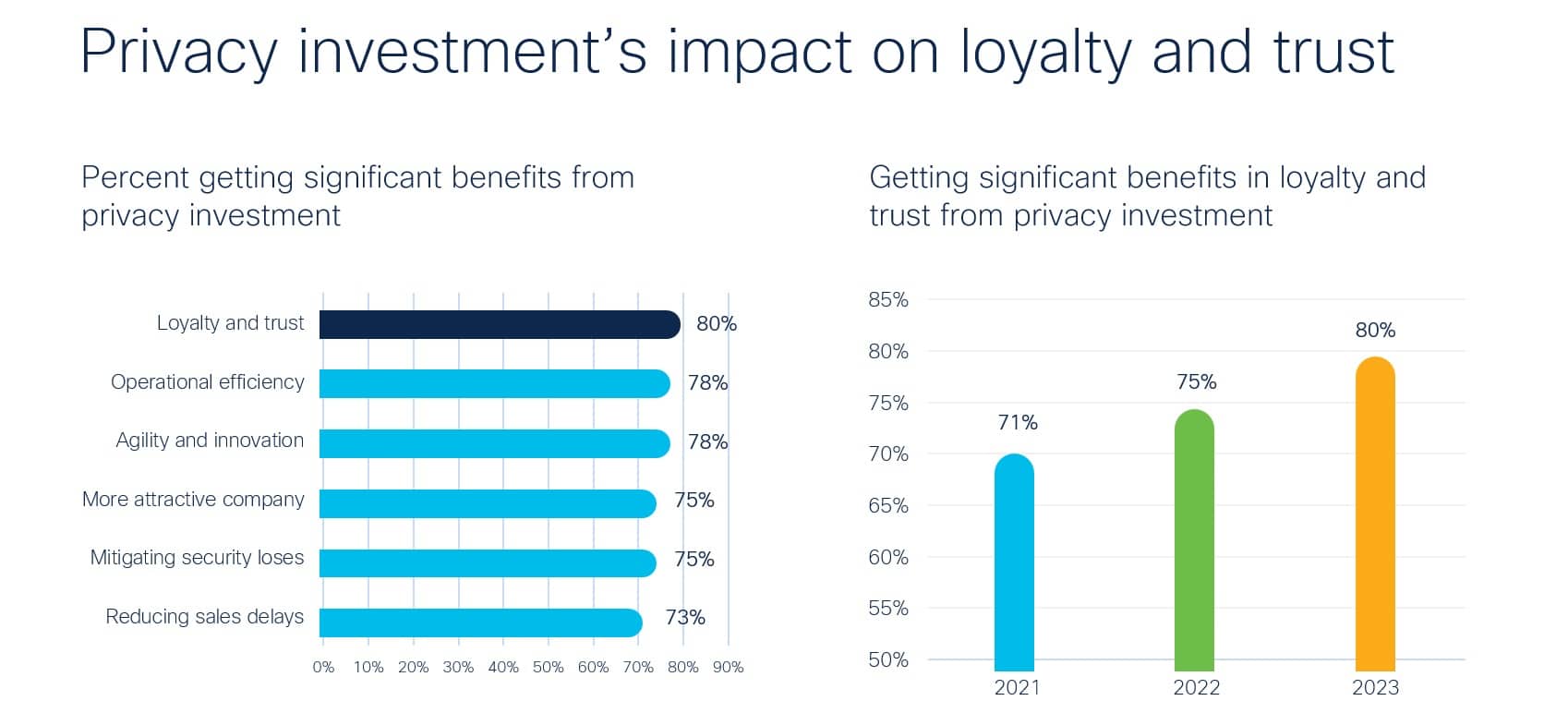

Prywatność: cenna inwestycja

W ciągu ostatnich pięciu lat wydatki na ochronę prywatności wzrosły ponad dwukrotnie. Korzyści wzrosły a zwroty z inwestycji pozostały na wysokim poziomie. W tym roku aż 95 proc. badanych wskazało, iż plusy z inwestycji w prywatność przewyższają koszty – przeciętna organizacja zgłasza, iż korzyści te przewyższają wydatki 1,6-krotnie. Co więcej, 80 proc. firm wskazało korzyści w zakresie „lojalności i zaufania” dzięki inwestycjom w prywatność, a odsetek ten pozostało wyższy (92 proc.) w przypadku najbardziej przygotowanych w tym zakresie organizacji.

W 2023 r. największe organizacje (zatrudniające ponad 10 000 pracowników) zwiększyły swoje wydatki na prywatność o siedem do ośmiu procent od ubiegłego roku. Jednak mniejsze organizacje cięły koszty. Na przykład firmy zatrudniające 50-249 pracowników zmniejszyły swoje inwestycje w prywatność średnio o jedną czwartą.

2 lat temu

2 lat temu

![10 obowiązków kadrowych przed sezonem urlopowym [Miniporadnik]](https://webp-konwerter.incdn.pl/eyJmIjoiaHR0cHM6Ly9nLmluZm9yLnBsL3AvX2ZpbG/VzLzM5MTU1MDAwL3VybG9wLXd5cG9jenlua293ZS1k/emlhbC1rYWRyLWktcGxhYy1vYm93aWF6a2ktcHJ6ZW/Qtc2V6b25lbS0zOTE1NDY3OS5qcGciLCJ3IjoxMjAwfQ.webp)